项目Projects

分布式深度学习算法

Distributed Deep Learning Algorithms

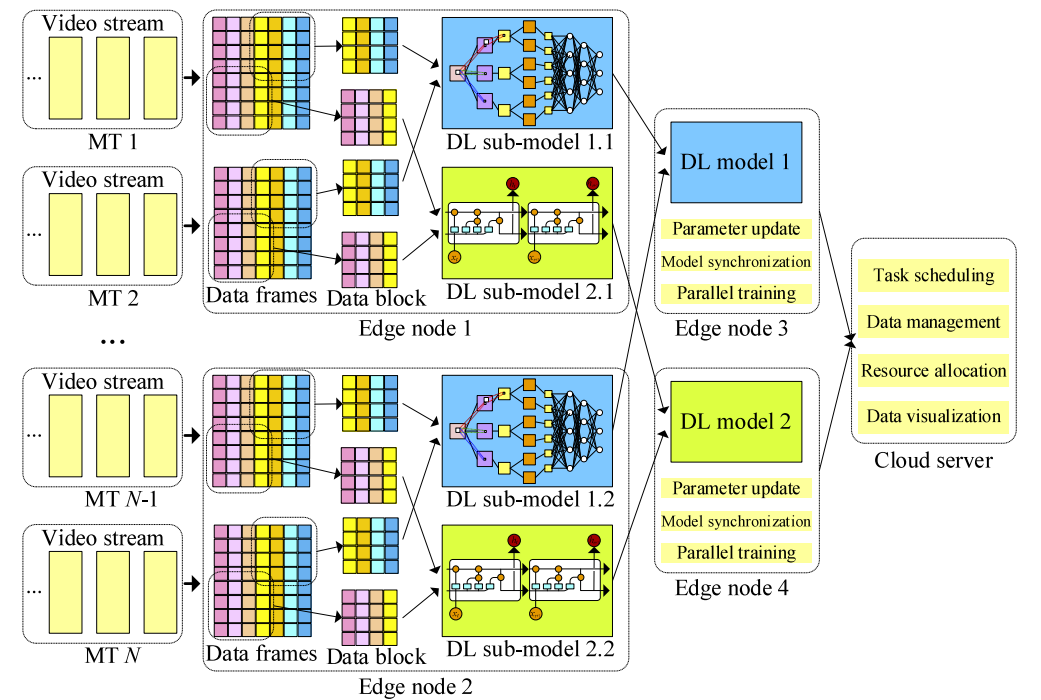

分布式深度学习算法研究课题的主要内容涵盖了分布式模型训练、模型参数同步与聚合、非独立同分布数据的处理、安全与隐私保护、资源动态调度与管理以及跨设备和边缘端深度学习等方面的内容,旨在解决分布式深度学习中的各种挑战和问题,推动其在实际应用中的发展和应用。

The main content of the distributed deep learning algorithm research topic covers distributed model training, model parameter synchronization and aggregation, non-independent and identically distributed data processing, security and privacy protection, dynamic resource scheduling and management, and cross-device and edge deep learning. The content aims to solve various challenges and problems in distributed deep learning and promote its development and application in practical applications.

The main content of the distributed deep learning algorithm research topic covers distributed model training, model parameter synchronization and aggregation, non-independent and identically distributed data processing, security and privacy protection, dynamic resource scheduling and management, and cross-device and edge deep learning. The content aims to solve various challenges and problems in distributed deep learning and promote its development and application in practical applications.

<p>分布式深度学习算法研究课题的主要研究内容涵盖了以下几个方面:</p>

<p>1. **分布式模型训练**:研究如何将深度学习模型训练过程分布到多个计算节点上进行,并协调不同节点之间的参数更新和模型同步,以提高模型训练的效率和速度。这包括优化分布式模型训练的通信开销、解决节点失效和延迟等问题。</p>

<p>2. **模型参数同步与聚合**:研究在分布式深度学习中如何有效地进行模型参数的同步和聚合,以保证在各个节点上训练的局部模型能够合理地融合为全局模型。这包括各种模型参数同步策略的设计和优化,如异步更新、同步更新、参数压缩等。</p>

<p>3. **非独立同分布数据的处理**:考虑到在分布式环境中不同节点上的数据可能具有不同的分布特征,研究如何调整模型和训练策略,以适应非独立同分布数据的情况,提高模型的泛化能力和适应性。</p>

<p>4. **安全与隐私保护**:研究如何在分布式深度学习中保护模型和数据的安全性和隐私性,防止模型参数和敏感数据在通信过程中泄露或被恶意篡改。这包括差分隐私技术的应用、安全多方计算等隐私保护手段的研究。</p>

<p>5. **资源动态调度与管理**:研究如何根据系统负载和资源状态动态调整分布式深度学习系统的计算资源分配和任务调度,以最大化系统的利用率和性能,提高系统的扩展性和灵活性。</p>

<p>6. **跨设备和边缘端深度学习**:研究在边缘端和跨设备的场景下如何进行分布式深度学习,以适应边缘计算和物联网等新兴应用场景的需求。这包括模型压缩与优化、跨设备模型协同训练等方面的研究。</p>

<p> </p>